IA tem potencial danoso

Pioneiro na pesquisa de desenvolvimento da Inteligência Artificial, o cientista Geoffrey Hinton deixa o Google e alerta sobre o perigo à frente quanto ao uso descontrolado da tecnologia. Ele está preocupado com os riscos à humanidade

O mundo vem discutindo nos últimos seis meses sobre o uso intensivo e os saltos acelerados no desenvolvimento da inteligência artificial. Do coração de sistemas de automação, ao uso da linguagem humana, passando pelo desenvolvimento de fotos hiperrealistas e desenhos geométricos e artísticos, a IA se faz presente e é hoje uma realidade que ameaça empregos, o senso crítico e até mesmo a humanidade.

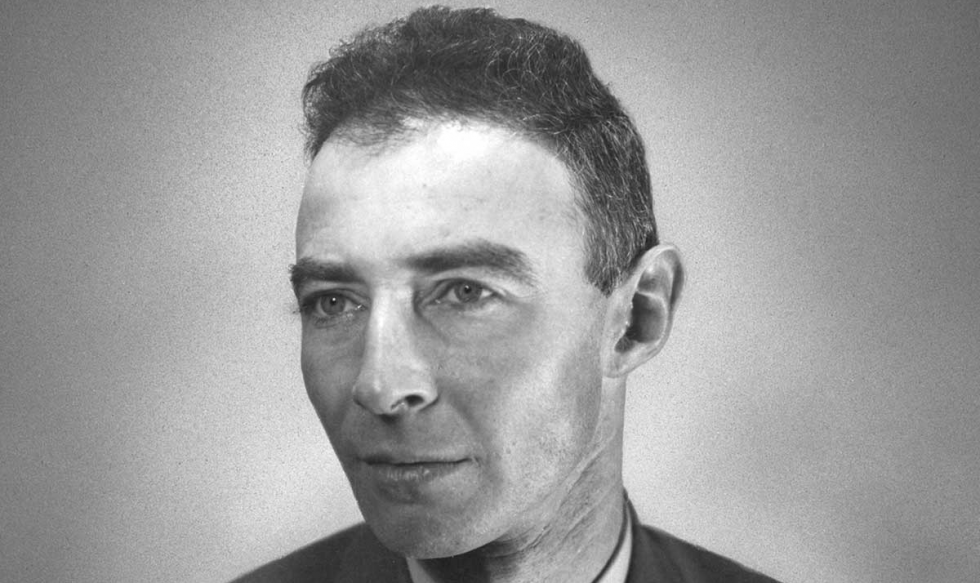

O alerta não é de um troglodita do século 20. Mas de ninguém menos do que Geoffrey Hinton, um dos pioneiros no desenvolvimento da inteligência artificial, que estava por trás das mais avançadas pesquisas realizadas pelo Google. Ele anunciou seu desligamento da gigante do Vale do Silício em reportagem publicada no início da última semana no New York Times. E assume; está muito preocupado.

Em 2012, Hinton e dois de seus alunos de pós-graduação na Universidade de Toronto, no Canadá, criaram tecnologia que se tornou a base intelectual para os sistemas de IA que as maiores empresas do setor de tecnologia acreditam ser a chave para o futuro.

Na segunda-feira, 1º de maio, Hinton se juntou ao coro dos descontentes e críticos que dizem que as big techs estão correndo em direção ao perigo com sua campanha agressiva para criar produtos baseados em inteligência artificial generativa, a tecnologia que alimenta chatbots populares como o ChatGPT, ou que está por trás de ferramentas de desenho, como Dream e Wonder.

Hinton largou seu emprego no Google, onde trabalhou por mais de uma década e se tornou uma das vozes mais respeitadas no campo da IA. Ele se arrepende do trabalho de sua vida. “Eu me consolo com a desculpa normal: se eu não tivesse feito isso, outra pessoa teria feito”, disse ao NYT.

O jornal alardeou, em reportagem de Cade Metz: “A jornada do Dr. Hinton de pioneiro da IA a apocalíptico marca um momento notável para a indústria de tecnologia, talvez em seu ponto de inflexão mais importante em décadas. Os líderes do setor acreditam que os novos sistemas de IA podem ser tão importantes quanto a introdução do navegador da web no início da década de 1990 e podem levar a avanços em áreas que vão desde a pesquisa de medicamentos até a educação”.

O repórter lembra, contudo, que muitos membros da indústria estão atormentados pelo medo de que estejam liberando algo perigoso na natureza. A IA geradora já é uma ferramenta para desinformação. Em breve, pode ser um risco para os empregos. Em algum lugar abaixo da linha, dizem os maiores cabeças da tecnologia, pode ser um risco para a humanidade. “É difícil ver como você pode evitar que os maus atores o usem para coisas ruins”, diz o Geoffrey Hinton.

Depois que a start-up OpenAI de São Francisco lançou uma nova versão do ChatGPT, em março de 2023, mais de mil líderes e pesquisadores de tecnologia assinaram uma carta aberta pedindo uma moratória de seis meses sobre o desenvolvimento de novos sistemas porque as tecnologias de IA representam “riscos profundos para a sociedade e a humanidade”.

Vários dias depois, 19 líderes atuais e antigos da Associação para o Avanço da Inteligência Artificial, uma sociedade acadêmica de 40 anos, divulgaram sua própria carta alertando sobre os riscos. Esse grupo incluiu Eric Horvitz, diretor científico da Microsoft, que implantou a tecnologia da OpenAI em uma ampla gama de produtos, incluindo seu mecanismo de pesquisa Bing.

Hinton, chamado pelo NYT de “padrinho da IA”, não assinou nenhuma das cartas e disse que não queria criticar publicamente o Google ou outras empresas até que deixasse o emprego. Mas ele revelou já ter notificado a empresa no mês passado que iria deixar a big tech.

O cientista-chefe do Google, Jeff Dean, disse em um comunicado: “Continuamos comprometidos com uma abordagem responsável da IA. Estamos continuamente aprendendo a entender os riscos emergentes, ao mesmo tempo em que inovamos com ousadia”.

Hinton é um expatriado britânico de 75 anos, acadêmico ao longo da vida cuja carreira foi impulsionada por suas convicções pessoais sobre o desenvolvimento e uso da IA. Em 1972, como estudante de pós-graduação na Universidade de Edimburgo, Hinton adotou uma ideia chamada rede neural — um sistema matemático que aprende habilidades analisando dados. Na época, poucos pesquisadores acreditavam na ideia. Mas se tornou o trabalho da vida dele.

Na década de 1980, Hinton era professor de ciência da computação na Universidade Carnegie Mellon, mas deixou a instituição porque relutava em aceitar o financiamento do Pentágono. Na época, a maioria das pesquisas de IA nos Estados Unidos era financiada pelo Departamento de Defesa. Ele se opõe profundamente ao uso de inteligência artificial no campo de batalha — que chama de “soldados robôs”.

Em 2012, Hinton e dois de seus alunos em Toronto, Ilya Sutskever e Alex Krishevsky, construíram uma rede neural que poderia analisar milhares de fotos e ensinar a identificar objetos comuns, como flores, cães e carros.

O Google gastou US$ 44 milhões para adquirir uma empresa iniciada por ele e seus dois alunos. E esse sistema levou à criação de tecnologias cada vez mais poderosas, incluindo novos chatbots como ChatGPT e Google Bard. Sutskever é hoje o cientista-chefe da OpenAI. Em 2018, Hinton e dois outros colaboradores de longa data receberam o Prêmio Turing, o “Nobel de Computação”, por seu trabalho em redes neurais.

Na mesma época, o Google, a OpenAI e outras empresas começaram a construir redes neurais que aprenderam com grandes quantidades de texto digital. Hinton achou que era uma maneira poderosa de as máquinas entenderem e gerarem a linguagem, mas era inferior à maneira como os humanos lidavam com a linguagem.

Então, no ano passado, à medida que o Google e o OpenAI construíram sistemas usando quantidades muito maiores de dados, sua visão mudou. Ele ainda acreditava que os sistemas eram inferiores ao cérebro humano em alguns aspectos, mas achava que estavam eclipsando a inteligência humana em outros. “Talvez o que está acontecendo nesses sistemas”, disse, “na verdade seja muito melhor do que o que está acontecendo no cérebro”.

À medida que as empresas melhoram seus sistemas de IA, ele acredita, estão se tornando cada vez mais perigosas. “Olhe como era há cinco anos e como é agora”, adverte. “Pegue a diferença e propague-a para frente. Isso é assustador”.

Ele lembra que, até o ano passado o Google agia como um “mordomo apropriado” para a tecnologia, tomando cuidado para não liberar algo que possa causar danos. Mas agora que a Microsoft aumentou seu mecanismo de pesquisa Bing com um chatbot — desafiando o negócio principal do Google — a empresa está correndo para implantar o mesmo tipo de tecnologia. Os gigantes da tecnologia estão presos em uma competição que pode ser impossível de parar.

Hinton diz que sua preocupação imediata é que a internet será inundada com fotos, vídeos e textos falsos, e a pessoa comum “não será mais capaz de saber o que é verdade”. Ele também está preocupado que as tecnologias de IA com o tempo irá virar o mercado de trabalho. Hoje, chatbots como o ChatGPT tendem a complementar os trabalhadores humanos, mas podem substituir advogados que ainda não passaram no exame da Ordem, assistentes pessoais, tradutores e outros que lidam com tarefas rotineiras. “Isso reduz o trabalho pesado. Mas pode tirar bem mais do que isso”, declarou ao NYT.

Hinton está preocupado que, no futuro, novas versões da tecnologia representem uma ameaça para a humanidade, porque muitas vezes aprendem comportamentos inesperados com as vastas quantidades de dados que analisam. Isso se torna um problema à medida que indivíduos e empresas permitem que os sistemas de IA não apenas gerem seu próprio código de computador, mas realmente executem esse código por conta própria. O professor teme um dia em que armas verdadeiramente autônomas — como robôs assassinos — se tornem realidade.

“A ideia de que essas coisas poderiam realmente ficar mais inteligentes do que as pessoas — algumas pessoas acreditavam nisso”, afirma. “Mas a maioria das pessoas achou que estava muito longe. E eu pensei que estava muito longe. Eu pensei que estava a 30 a 50 anos ou até mais de distância. Obviamente, eu não acho mais isso”.

Outros especialistas, incluindo muitos de seus alunos e colegas, dizem que tal ameaça é hipotética. Mas Hinton acredita que a corrida entre o Google e a Microsoft e outros se transformará em uma corrida global que não vai parar sem algum tipo de regulamentação planetária ou determinada pelo concerto das nações.

Ele conjectura, contudo, que isso pode ser impossível. Ao contrário das armas nucleares, diz Hinton, não há como saber se empresas ou países estão trabalhando nessa tecnologia em segredo. A melhor esperança é que os principais cientistas do mundo colaborem para permitir ou construir algum tipo de controle da tecnologia. “Eu não acho que eles devam escalar isso mais até que entendam se podem controlá-lo”, argumenta.

Hinton disse que quando as pessoas costumavam perguntar a ele como poderia trabalhar em tecnologia potencialmente perigosa, ele parafraseava Robert Oppenheimer, o cientista que liderou o esforço dos EUA para construir a primeira bomba atômica: “Quando você vê algo que é tecnicamente doce, vá em frente e faça isso”. Mas nem Hinton não diz mais isso.

Vale lembrar que Oppenheimer, após perceber as consequências do uso da bomba atômica, no Projeto Manhattan, lembrou-se de uma frase presente no livro sagrado hindu Baghavad-Gita: “Agora eu me tornei a morte, a destruidora de mundos”. •